기술 발전 속 AI의 책임

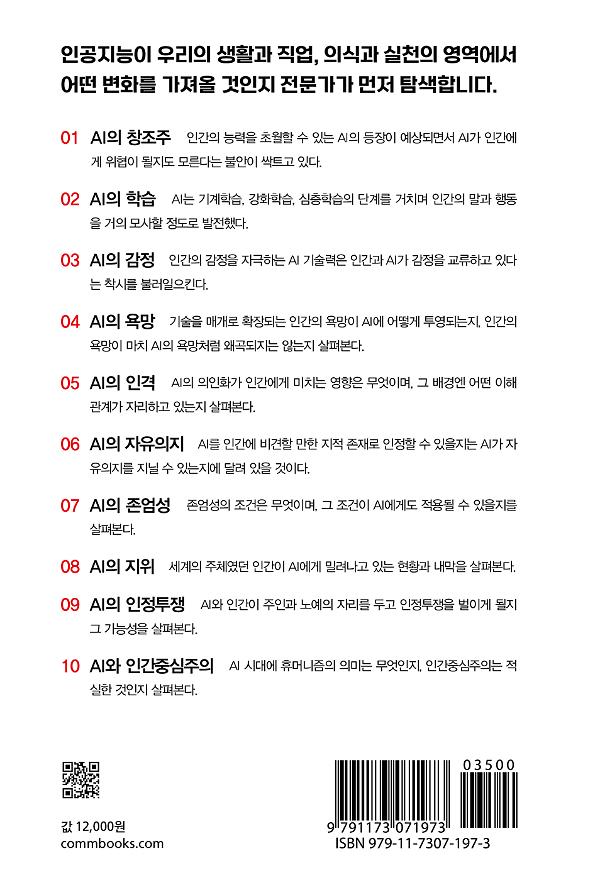

AI의 발전에 따른 윤리적, 사회적 책임을 깊이 탐구하는 책이다. 우리는 AI가 ‘지능’, ‘학습’, ‘자율’, ‘감정’과 같은 인간적 개념을 갖춘 것으로 착각하곤 하지만 AI의 작동 원리는 인간이 만든 개념과는 전혀 다른 메커니즘에 기반한다. 따라서 AI의 기술적 특성을 올바르게 이해하고, 이를 인간중심주의 관점에서 다시 평가해야 한다. AI는 인간이 설계하고 제어하는 도구이며, 그 책임 또한 인간에게 있다.

이 책은 AI가 인간과 비슷한 방식으로 사고하거나 자율적으로 결정을 내릴 수 있다는 오해를 불식시키며 AI가 제공하는 정보의 신뢰성 문제를 다룬다. 특히, AI의 ‘블랙박스’ 문제와 편향성 논란을 제기하며, 이를 해결하기 위한 방법으로 설명 가능한 AI(XAI)나 신뢰할 수 있는 AI 설계의 중요성을 강조한다. AI가 발전하면서 발생할 수 있는 사회적 불안감과 법적 논란을 해소하기 위해 AI에게 법적 권리나 의무를 부여하는 것보다 AI의 개발과 활용에 대한 인간의 책임을 명확히 하는 것이 중요하다. 민주주의와 법치주의가 AI 기술의 발전을 선도해야 한다.

이 책은 AI의 미래에 대한 논의에서 발생할 수 있는 오류와 위협을 점검하며, 인간중심주의의 원리에 입각해 AI와 공존할 수 있는 구체적인 해결책을 제시한다. AI를 개발하고 활용하는 주체인 인간의 책임을 상기시키며, 기술이 인간을 넘어서는 것을 방지할 수 있는 방안을 논의한다. AI 기술 발전 속에서 인간의 책임을 잊지 않고, AI의 발전이 사회와 법을 위협하지 않도록 하는 방향을 제시한다.