언어 처리에는 여러 개의 하위 분야가 있다. 문장 생성, 언어 간 번역, 문서 요약, 질의ᐨ응답 등 여러 작업이 있는데, 이러한 여러 작업에 범용으로 사용할 수 있게 튜닝이 가능하다. 일반적으로 비교적 적은 모델 데이터를 가지고도 여러 다른 막대한 작업 데이터에 적용해서 높은 성능을 발휘할 수 있는 효율성이 있다.

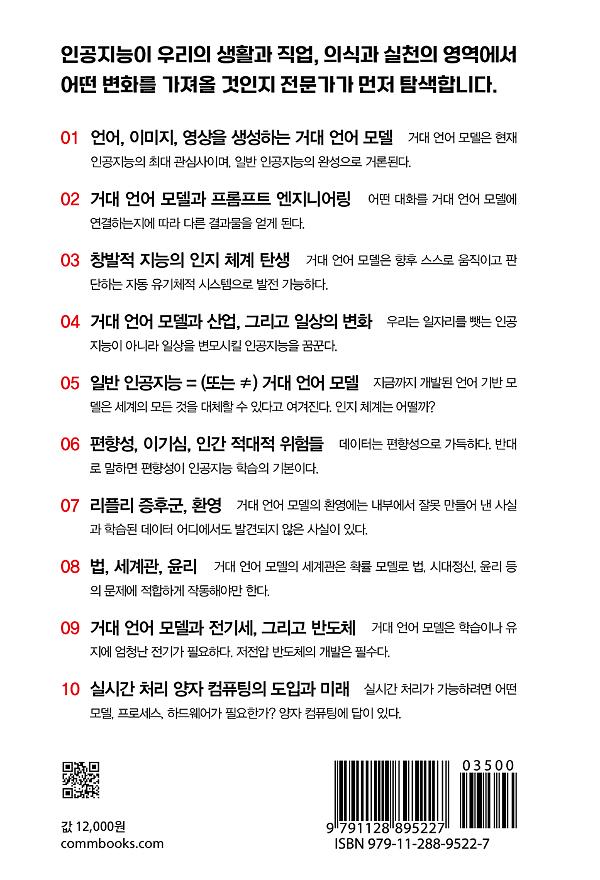

-01_“언어, 이미지, 영상을 생성하는 거대 언어 모델” 중에서

인공지능은 이제는 앨빈 토플러가 생각하는 미래의 충격으로 다가오지는 않는다. 현실에서 인공지능을 대하지만 우리는 인공지능이 우리를 완전히 대체해서 우리의 일자리를 뺏는 것을 원하지는 않는다. 우리는 현재 우리의 일상을 변모시킬 인공지능을 꿈꾸고 있다. 과거에 얻기 힘들었던 향유물을 일상에서 누리는 정도의 변화를 고민하고 있다. 인공지능의 미래도 무한하면서 지속 가능한 것을 바라고 있다. 이것이 우리가 인공지능을 설계하면서 꿈꾸면서 고민하는 것들이다.

-04_“거대 언어 모델과 산업, 그리고 일상의 변화” 중에서

편향성이 지니는 또 다른 문제점은 바로 다중 언어 모델에 대한 것이다. 거대 언어 모델의 출발점은 미국으로, 영어 텍스트를 중심으로 학습되었다. 초기 모델들은 영어 기반으로 작성되었으며, 이후 여러 다른 언어와 번역 모델을 결합한 형태도 있다. 이러한 경우에 영어에 기반을 두고 있어서 영어, 즉 미국과 영국적 사고방식이나 세계관이 많이 들어 있어서 다른 언어나 다른 세계관을 표방하기는 어렵다. 따라서 이러한 모델들을 그대로 차용하는 경우에는 영어를 사용하지 않는 다른 국가나 세계에서는 문제가 되기도 한다. 이를테면 과거 영국의 식민지였던 곳들에서는 식민지적 사고방식이 그대로 반영될 수도 있다. 이러한 이유로 제3세계나 인도, 중국 등에서는 거대 언어 모델의 주권화를 표방하기도 한다.

-06_“편향성, 이기심, 인간 적대적 위험들 중에서

거대 언어 모델은 인간 뉴런을 모사하는 딥러닝 아키텍처에 기반을 두고 있다. 따라서 전반적으로 인간 뇌와 어떠한 차이점이 있는지, 그리고 만약 인간 뇌와 유사하게 바꾼다면 어떠할 것인지도 논의할 필요가 있다. 생물체인 인간 뇌와 유사해지면 전기 소모량이 줄 것이라는 가능성도 커다란 관심 항목이다.

-09_“거대 언어 모델과 전기세, 그리고 반도체” 중에서